Un año histórico para la democracia

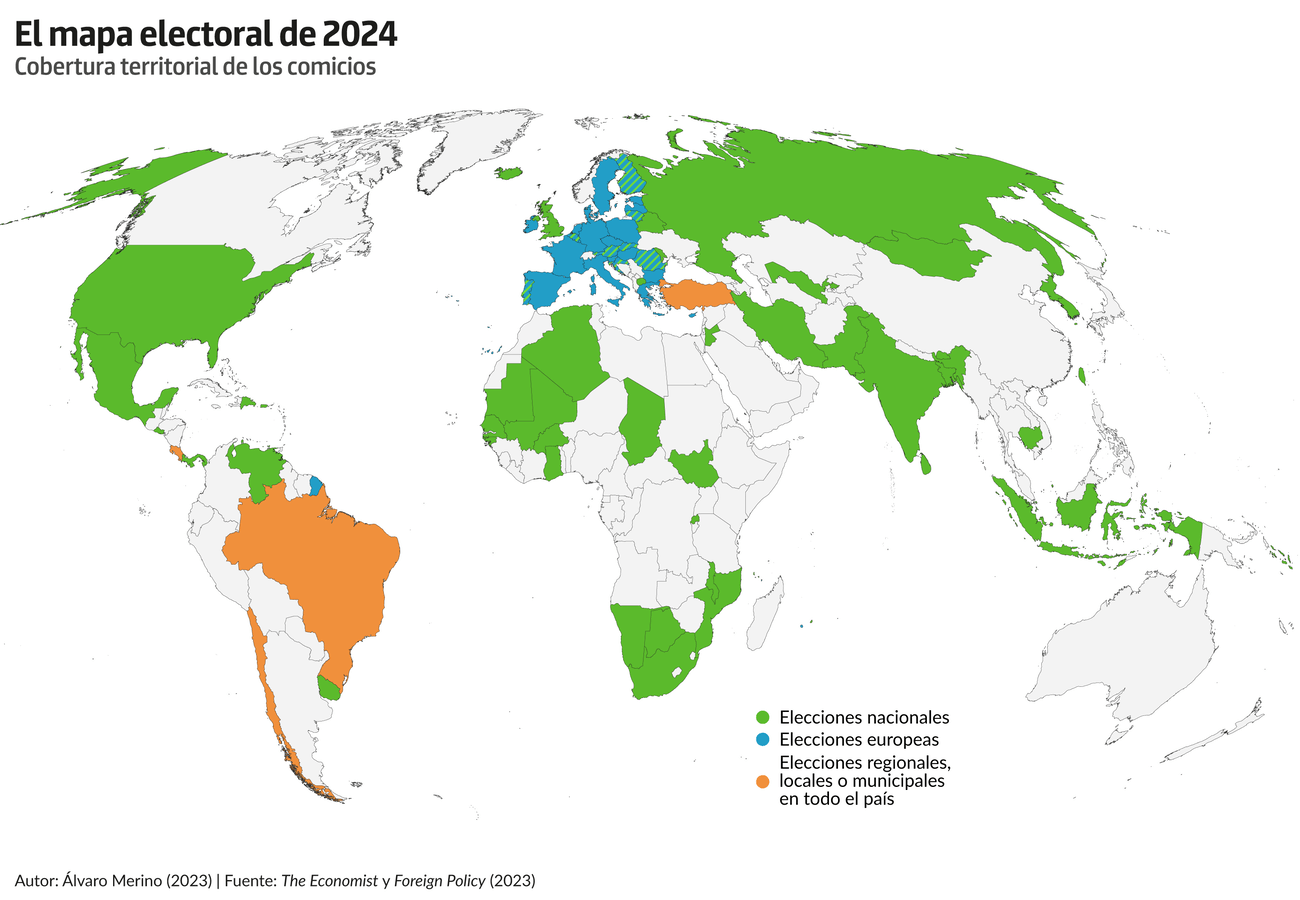

El año 2024 será histórico para la democracia, pues por primera vez la mitad de la población mundial votará en 79 países celebrando 87 procesos electorales. Y lo hará en circunstancias particularmente delicadas e inciertas.

Si en cualquier régimen político la información es vital para controlar y orquestar el poder, en las democracias es especialmente relevante por diversos motivos. Los principales hunden su nervio en la legitimidad sobre la que se sostiene el modelo democrático, como facilitar una participación política formada, supervisar y controlar al poder para prevenir sus abusos, garantizar la transparencia y la rendición de cuentas, y facilitar en general el debate público y la deliberación que alimentan la toma de decisiones. En todos ellos, la información es crucial.

Sin embargo, la apertura de las sociedades abiertas, tal y como las llamó Popper, es no sólo quizá su mayor virtud sino también un excelente punto débil. Si el analfabetismo o la adulteración de los medios de comunicación han sido históricamente aprovechados por la propaganda para debilitar cualquier régimen político, ahora cabe plantearse si la mejora en nuestra capacidad informativa y nuestra formación cívica en democracia se ha desarrollado al mismo ritmo que la capacidad tecnológica para la propaganda y la manipulación social. Porque es posible que nunca como hasta ahora haya sido posible interferir en los procesos democráticos de una forma tan masiva y potente.

Una sociedad abierta logra su legitimidad porque es razonablemente transparente, porque tolera la diversidad de opiniones y por tanto expone el torrente de información que la vertebra a la luz del día. Pero ello hace que la libertad de expresión pueda convertirse en un salvoconducto para quienes desean contaminarla y sutilmente minar nuestro derecho a la información veraz. Ningún medio puede ser totalmente inmune a ello. Sin ir más lejos, algunos escritores nazis ya han puesto en un brete a esta propia plataforma.

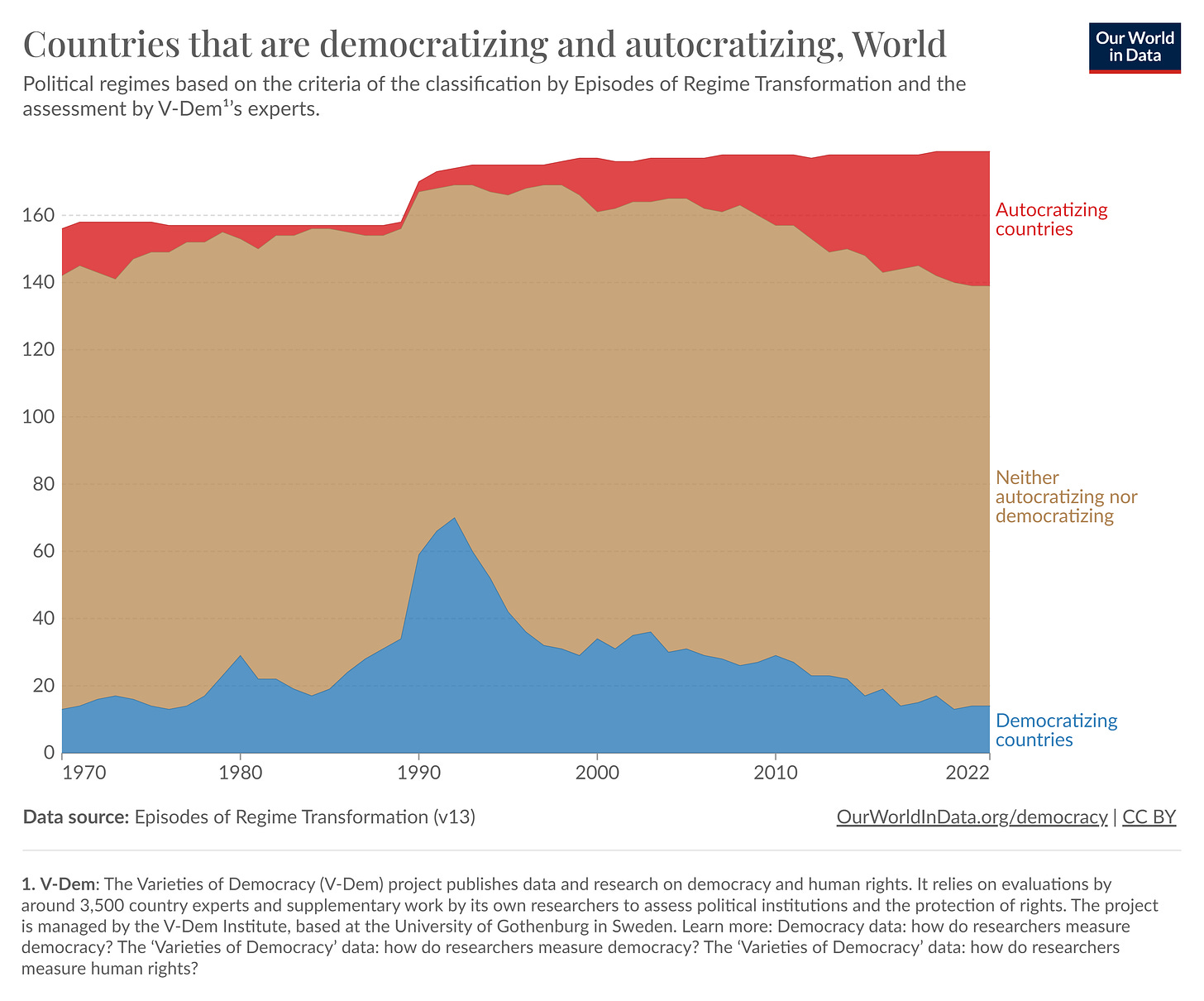

Desde que hace unos 10.000 años nos sedentarizamos, los regímenes democráticos han sido una absoluta excepción que apenas ha durado un 2% del tiempo, y casi siempre de forma parcial. Ciertamente, las democracias están relacionados con el crecimiento económico más eficiente y son quienes parecen recaudar mejor gracias al reconocimiento de su legitimidad que mejora la moral fiscal. Pero precisamente por su carácter abierto, su fragilidad es alta, y nunca deben darse por supuesto, a pesar de que muchos hayamos nacido y vivido toda nuestra vida en ella. De hecho, desde hace unos años, en particular tras la Gran Recesión de 2008, las democracias muestran una tendencia en retroceso en el mundo, tal y como vimos sobre las propuestas por un Estado mínimo. En esta situación, votamos este año expuestos a la propaganda potenciada por la IA generativa. Pero ¿será tan grave el asunto?

Domando al crecimiento de la información

La acumulación de información ha resultado ventajosa cuando hemos podido depurarla para encontrar formas útiles, estructuras complejas efectivas para vivir mejor. Las revoluciones del lenguaje, la escritura o la imprenta nos lo recuerdan. Pero si la tasa de absorción de este crecimiento de información no resulta suficiente, la información se convierte en ruido, en desorden y entropía. Vivimos una época en la que su desbordamiento vuelve a tensar este equilibrio enredándonos en una algarabía de voces, datos y opiniones: hoy el esfuerzo necesario para distinguir la información relevante de la infobasura, la verdad basada en hechos de la posverdad basada en fakenews, es de especial intensidad.

El explosivo crecimiento de la información nos ha empujado a desarrollar tecnologías como las de Big Data que tratan de optimizar el tratamiento del ingente volumen de datos y aprovechar potenciales usos que antes nos estaban vedados. Pero eso ha expuesto aún más algunos de los principios más elementales de las democracias, como la innegociable inviolabilidad del individuo y el respeto máximo por su libertad (de voto, de compra, de emprendimiento, de asociación política,…). Decía W. Churchill que la democracia es probablemente el peor de todos los sistemas políticos, a excepción del resto, consciente de sus carencias y posibles degeneraciones hacia la demagogia, como tantos pensadores han cuestionado a lo largo de la historia. Pero estribaba su virtud en que mediante la información podía mitigar sus propios desvaríos y autorectificarse. ¿Pero qué sucede cuando la manipulación de la opinión pública es optimizada hasta niveles insospechados?

El escándalo de Facebook y Cambridge Analytica de la pasada década fue un hito especialmente señalado en este proceso de optimización de la propaganda política y que tensó los regímenes democráticos en sucesivas elecciones. Aprovechando el perfilado basado en datos, el microtargeting - la microsegmentación de la propaganda - permitió influir en unos pocos millones de usuarios, suficientes como para que las campañas de Trump o el Brexit de 2016 se vieran sensiblemente orientadas. Zuckerberg recorrió comisiones en el Senado y en la Eurocámara poniendo excusas, pidiendo disculpas y prometiendo enmiendas, y las clásicas medidas antimonopolísticas volvieron a resonar. Pero la capacidad de regulación de los Estados para lidiar con los gigantes transnacionales es limitada.

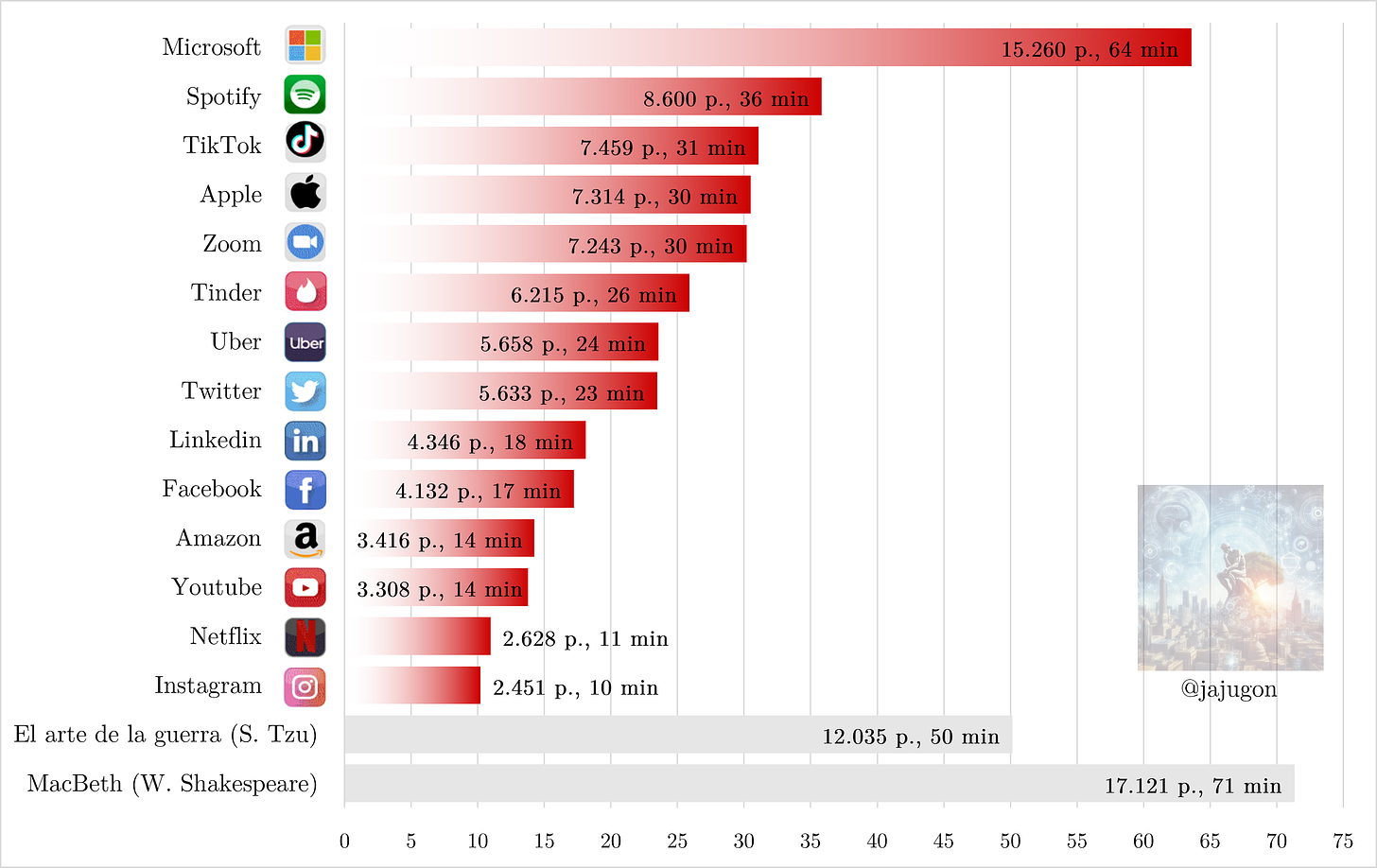

La democracia, incluso en Europa, nos deja desprotegidos. Entregamos nuestra alma, perfilada de datos, a los grandes gigantes tecnológicos a cambio de un montón de servicios gratuitos que nos exprimen mucho más de lo que sospechamos. Somos incapaces de leer y procesar e incluso de rechazar las extensísimas políticas de uso y condiciones que abusan, de nuevo, de la infoxicación, para chantajearnos con la alternativa de no aceptarlas y de vernos condenados al “ostracismo digital”. Basta comparar lo que tardaríamos en leer sus condiciones frente a algunas obras clásicas.

Sin embargo, en el contexto de desafección ciudadana actual sobre las democracias, es difícil pensar que los ciudadanos en su mayoría estén dispuestos como alternativa a entregar a los Estados la responsabilidad de mejorar esa asimétrica negociación entre el usuario digital y el gigante tecnológico privado. La supervisión política de nuestros datos no reviste mejores niveles de confianza.

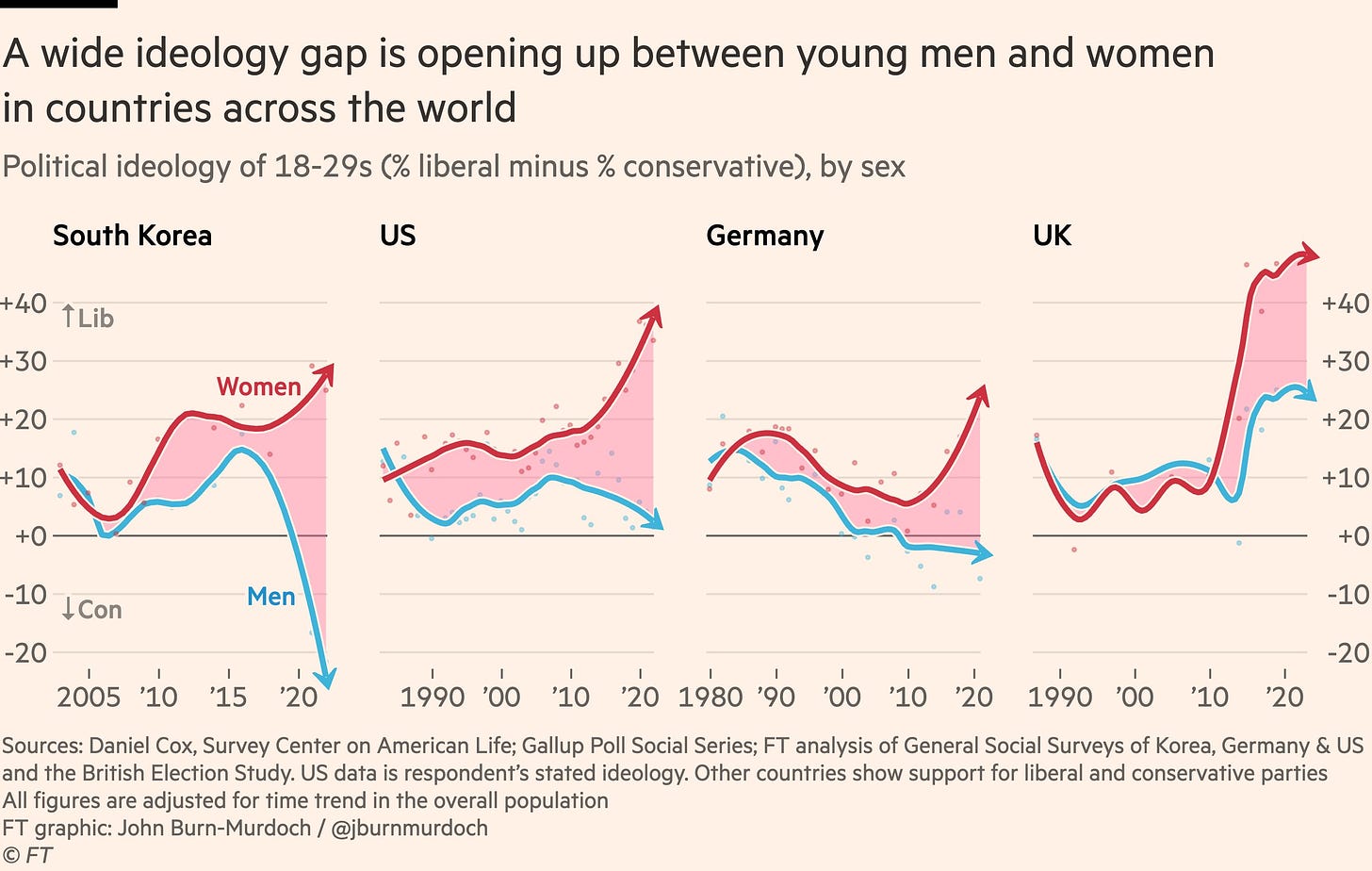

Por otra parte, si la democracia pasa por procesos deliberativos que buscan puntos de consenso, negociaciones y acuerdos dentro de la pluralidad, una forma que atenta contra ellos es la manida polarización en las opiniones sociales. Y como es bien sabido, este es precisamente el efecto que las tecnologías que maximizan nuestra atención para monetizarla están produciendo en las redes sociales, donde se crean cámaras de eco y de resonancia que exacerban las posiciones. Hace poco publicaban otro estudio acerca de la creciente y preocupante polarización política entre hombres y mujeres.

La IA generativa, ¿un punto disruptivo?

Para algunos autores, la nueva capacidad de la IA generativa para generar contenido como imágenes, música, texto y vídeos, entre otros, de manera autónoma y a menudo indistinguible del trabajo humano es un punto de inflexión en este proceso. La IA generativa acelera la capacidad para la manipulación y el sesgo en el discurso público, creando contenido falso o engañoso mucho más creíble. Estamos viendo cómo se están creando granjas de spam para inundar, y cómo rostros sintéticos promediados y generados por IA generan más confianza que las irregulares caras humanas reales. Recientemente, hemos sabido de un empleado engañado en una videoconferencia falsificada al que convencieron para robar a la empresa 25 millones de euros.

En manos de intereses políticos, estas capacidades pueden generar combustible emocional incendiario, con la habilidad para influir en la opinión pública y acelerar el socavamiento de la confianza en las instituciones democráticas. Los ejemplos de deepfakes en fotos y vídeos sobre declaraciones o eventos que no se han producido y que pueden exacerbar al más exaltado estremecen. Por ejemplo, la de una detención inexistente que incentive un golpe de Estado. Incluso tres años después, la polarización informativa sigue persistiendo en justificar o rebajar el golpe de Estado que supuso el asalto al Capitolio.

La posibilidad de personalizar el contenido según las preferencias individuales y robustecer las burbujas de filtro o cámaras de eco mediante la IA generativa dificultará aún más el diálogo y el compromiso cívico. Además, la IA generativa puede amplificar y enquistar los sesgos sociales existentes, incorporando y reafirmando prejuicios y desigualdades raciales o sexistas en un claro desafío a la aspiración democrática por la equidad y la justicia. Su capacidad para producir desinformación será más generalizada, más persuasiva, más personalizada y tendrá un mayor alcance.

Para algunos, sin embargo, una excesiva preocupación por la desinformación puede resultar contraproducente, y generar aún más rebeldía y polarización. Si el análisis es excesivamente laxo en sus evaluaciones sobre lo que es o no desinformación, acabará proyectando una posición de autoridad epistémica que resulte elitista y alejada de la esfera pública. Hablar tanto de desinformación parecerá de esnobs. Ello puede aumentar la desconfianza y enojo entre el público general y dañar así las democracias de sufragio universal. Por otro lado, la exageración de los medios de comunicación con la desinformación está mermando su propia credibilidad, pegándose un tiro en el pie. Además, los políticos pueden aprovecharse de ese ruido sobre los deepfakes para excusarse ante las pruebas que los incriminen, en lo que se ha llamado el dividendo del mentiroso, que explota en bucle la desinformación sobre la desinformación.

En realidad, hasta ahora hemos tendido a sobreestimar la desinformación real. De hecho, la mitad de los estadounidenses ya cree que la información errónea difundida por la IA impactará en las próximas elecciones presidenciales, aunque aún falten evidencias. Además, en la práctica, el impacto de la desinformación es limitado: la inmensa mayoría de la población consume pocas noticias falsas en todo tipo de plataformas. Además, vota por convicciones irracionales que no son tan manipulables mediante la propaganda, y pocas capas de indecisos alteran su voto en función de los impactos informativos que reciben.

Sin embargo, aunque quepa corregir los deslices de esta preocupación, no puede ignorarse que la IA generativa va a poder aprovechar la expansión a nuevas capas de la población, como los jóvenes, que comparten menos desinformación que los mayores pero se la creen más. Cada vez más plataformas como X/Twitter o Facebook están siguiendo la estela de TikTok (controlada desde la autocrática China) de posicionar vídeos basados en recomendaciones algorítmicas en lugar de vínculos sociales, lo que podría servir a potenciales intereses geoestratégicos. Diversos estudios muestran que es posible crear una “máquina de manipulación” altamente escalable que se dirija a individuos en función de sus vulnerabilidades únicas sin requerir intervención humana.

Para abordar estos desafíos, será fundamental seguir desarrollando marcos éticos - ¿bajo qué incentivos? - y regulaciones efectivas - ¿sobre qué gobernanza mundial? - que guíen el desarrollo y el uso responsable de la IA generativa, así como profundizar en la investigación acerca de su impacto real en la información. Es posible que ya no sea suficiente que los proveedores de búsqueda combatan la desinformación utilizando simplemente sistemas automatizados para restar prioridad a las fuentes sin evidencia o fundamento. La democracia podría estar en juego, así que debe apuntarse a la transparencia en los algoritmos utilizados, la protección de la privacidad y la seguridad de los datos, la alfabetización mediática, la promoción de la diversidad y la inclusión en el diseño de sistemas de IA, y la educación pública sobre los riesgos y beneficios de esta tecnología. Pero una implementación que no cercene a la innovación no es nada evidente. Y la competencia geopolítica global por desarrollarla es feroz.

Un nuevo óptimo en la sociodiversidad será imprescindible para preservar la inteligencia colectiva necesaria para lidiar con el futuro. Porque es posible que la complejidad - y por tanto la incertidumbre - estén creciendo a un ritmo incluso mayor que nuestras tecnologías más avanzadas. Y en ese escenario sólo esa inteligencia colectiva podrá responder afirmativamente a la posibilidad de que la democracia sobreviva al Big Data y a la IA. La encrucijada podría hallarse en si finalmente son unos pocos los que acaban tomando las decisiones que controlan los nuevos algoritmos cada vez más poderosos para reducir nuestra autodeterminación (feudalismo 2.0) o si encontramos la oportunidad de evolucionar hacia una democracia digital (democracia 2.0) que preserve y desarrolle esa inteligencia colectiva democrática. En las elecciones de este año podríamos vivir, en ese sentido, una importante prueba de toque.

Sin embargo, de momento, parece que si la información manipulada es dañina, no es tanto a nivel epistémico sino demagógico: no suelen colarnos falsificaciones, pero nos gustan. Forman parte de esa política escandalosa que se sirve de la desinformación porque condensa pensamientos complejos en imágenes clarificadoras y conmovedoras (memes, gifs,…). Amplifican nuestras opiniones en lugar de hacerlas más complejas y profundas. La democracia puede embarrarse sin necesidad de la IA si la política se sigue infantilizando y convirtiendo en un deporte que se gana insultando al oponente de la forma más entretenida. Verificar la información manipulada no parece que sea nuestra necesidad más urgente, porque el problema no es la verdad que ocultan estas falsificaciones sino la que muestran: Que las democracias sufren carencias preocupantes independientemente de la IA. Veamos este año por dónde se ven las costuras.

El problema de mas urgencia a nivel político lo tenemos, a mi parecer, con el concepto de "desinformación". Si entendemos por ella el dar una serie de datos que no sean reales por un interés político o privado, entonces resulta evidente que la desinformación es ejercida por los medios de información masivos, así también como por declaraciones de la clase política e instituciones de todo tipo. Como dices, la interpretación o narrativa de los datos no es información falsa, ni tampoco la maniquea clasificación con epítetos ad hominem bien efectivos como "negacionista".

Resulta curioso cómo se busca dar caza a la "desinformación" por organismos e instituciones que ellos mismos desinforman, si nos atenemos a la definición dada (e incluso desinforman más que medios "negacionistas", pues estos afirman enunciados particulares que son ciertos en su "particularidad" mientras que los primeros afirman enunciados universales que son falsos en muchas ocasiones). Resulta difícil no ver esto como un adueñamiento de la "verdad", de lo qué es válido y no, como muestran los intentos de reglar (es decir, censurar) mediante ley y penas medios de difusión alternativos (por no hablar de la "censura blanda" en cuanto a visibilidad, facilidad de acceso y demás...) en nombre de ciertos preceptos morales y de "proteger al consumidor".

La única solución que veo a título individual es atenderse a una disciplina epistémica y ética para diferenciar los hechos (o datos) particulares de los hechos (o datos) universales, pues por mero "modus tollens", un dato particular refuta una proposición universal.

Por ejemplo:

- Si las vacunas del Covid tienen un sólo caso de muerte causado por ellas, el qué desinforma es el que afirma universalmente que estas no lo tienen (como el que, claro está, afirma que matan a todo Cristo).

- Si el exceso de mortalidad registrado en determinados grupos de edad en distintos países correlacionado con la vacunación es superior a las muertes registradas de ese mismo grupo de edad, afirmar esto no es "desinformar", sino informar de unos hechos que deben analizarse.

- Si los huties dejan pasar un buque de determinado país, entonces no bloquean el transporte marítimo global, sino sólo a determinados buques.

Creo vital aplicar está distinción epistémica para poder diferenciar qué es un hecho y qué no lo es, qué es verdad y qué no lo es. De este modo, podemos defender la publicación de cualquier hecho y exigir verdad en los hechos; y diferenciarlos de las opiniones que, a mí entender, pueden ser expresadas libremente siempre y cuando no atenten a la violencia de forma evidente y obvia contra alguien.

A título social, la única opción viable es la defensa de la libertad de expresión; el rechazo frontal de toda censura, puesto que otorgar a determinadas instituciones con intereses la potestad de prohibir (aun si efectivamente se ha desinformado) nos puede llevar a problemas futuros; y la pluralidad de fuentes de información que puedan contradecir con hechos y argumentación.

La "paradoja de la tolerancia" viene a decir que debemos censurar al que proclama una intención de censurar para evitar que, si su poder crece, este prohíba la libertad de expresión. No proclama censurar al que dice cosas que no nos gustan. Visto lo visto, cabe preguntarse a quién deberíamos censurar; y según tal "paradoja", deberíamos censurar a los censores oficiales que defienden una censura de aquellos que no muestran intención de censurar, pues esto llevará a la prohibición de la libertad de expresión en un futuro.